À l’occasion du Meta Connect de septembre 2023, les lunettes connectées entrent dans l’ère de l’intelligence artificielle embarquée, avec Meta et Google en tête de course pour transformer ces montures en assistants visuels discrets et proactifs. Alors que les Ray-Ban Meta Stories intègrent déjà Meta AI pour des interactions vocales en temps réel, les annonces récentes promettent une analyse visuelle du monde environnant d’ici 2024, redéfinissant notre rapport à la technologie quotidienne.

Meta Connect 2023 : l’IA au cœur des Ray-Ban Meta

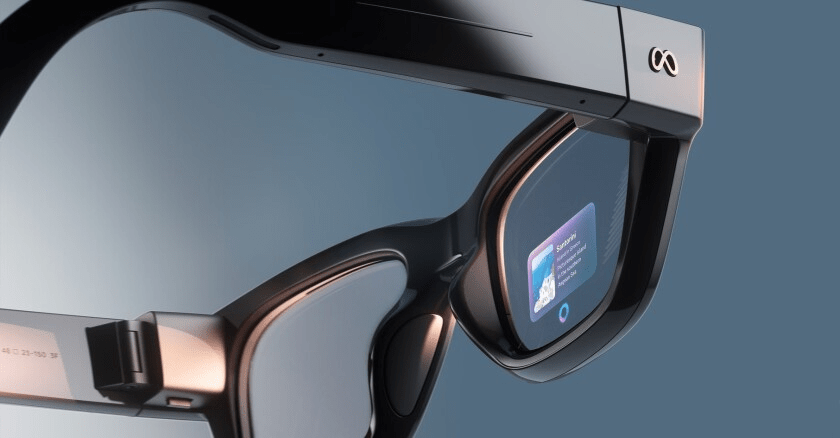

Lors de la conférence Meta Connect 2023, Mark Zuckerberg a dévoilé la deuxième génération des Ray-Ban Stories, rebaptisées Ray-Ban Meta, lancées le 17 octobre à partir de 329 €. Ces lunettes intègrent Meta AI, premier assistant IA multimodal fonctionnant mains libres : posez des questions sur ce que vous voyez (« Qu’est-ce que c’est ? »), capturez photos/vidéos en 1080p à 60 fps, ou obtenez des réponses contextuelles même en environnement bruyant grâce à cinq micros et une puce Snapdragon AR1 Gen 1.

Une mise à jour gratuite prévue en 2024 permettra à l’IA d’analyser l’environnement en direct pour suggérer recettes, traductions ou infos, posant les bases d’un « superpouvoir visuel ». Meta vise une production de masse accessible, après les ~300 000 unités vendues des premières Stories.

Google entre dans la danse avec des brevets AR-IA

Google accélère avec des brevets pour lunettes AR compatibles Android, intégrant Gemini (son IA avancée) pour superposer des informations en réalité augmentée : directions GPS, identification d’objets, ou analyse nutritionnelle d’un plat scanné, sans dépendre uniquement du smartphone. Des partenariats avec Samsung et des lunetiers comme Gentle Monster préparent un lancement 2024-2025, avec traitement local pour la confidentialité.

Ces prototypes visent un champ de vision large (jusqu’à 70° comme chez Meta Orion teasé), avec eye-tracking et commandes gestuelles, pour concurrencer les rumeurs Apple Glass.

Vers un assistant omniprésent en 2024

L’IA embarquée promet des usages révolutionnaires : santé (détection précoce via capteurs rétiniens), accessibilité (lecture audio live), ou productivité (rappels contextuels). Meta tease Orion, prototype AR holographique léger (<100g) présenté en 2023, avec contrôle neuronal et affichage direct sur la rétine pour un métaverse fluide.

Malgré les défis éthiques (vie privée des caméras), 2024 s’annonce comme l’année de l’adoption massive, avec des millions d’unités et une convergence IA-optique qui bouscule les opticiens traditionnels.

Sources